En el número 30 de la revista u-Gob me publicaron este artículo. Los invito a leer uy compartirlo.

Al representar la Inteligencia Artificial (IA) un mar de ventajas y beneficios, su uso en gobierno abre un mundo de posibilidades casi inimaginable, por lo que es más atractiva la idea de su uso que la de su regulación, que en ese caso, es también una de las responsabilidades de la administración pública, ya que como lo menciono en uno de mis artículos recientes, la AI a es también un arma de dos filos.

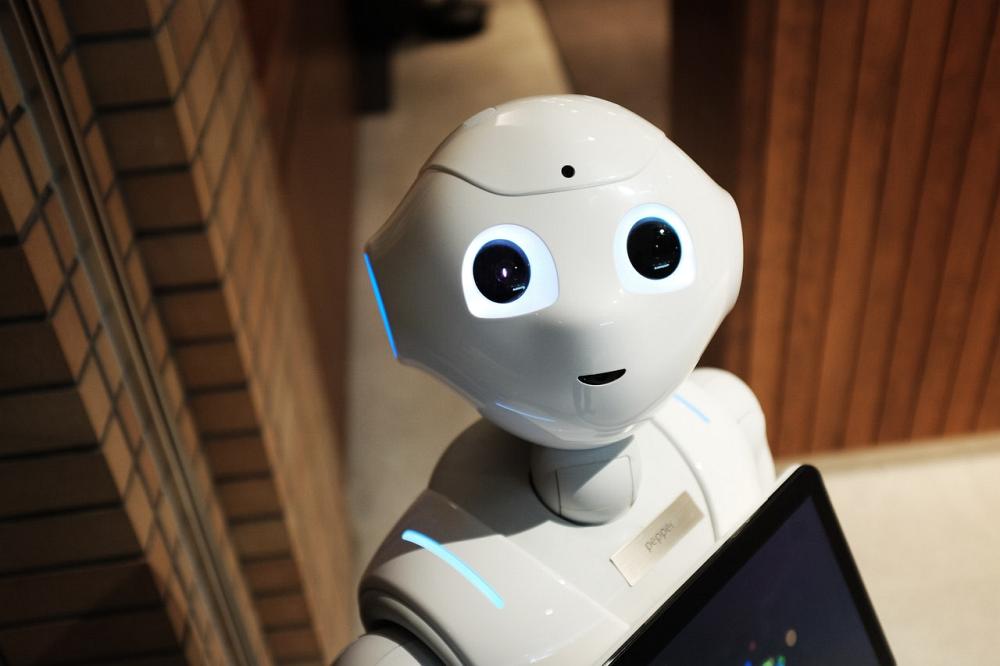

El uso de la IA en el gobierno representa una gama de posibilidades en operatividad, ya que es capaz de mejorar sus tareas de servicio público para hacerlas más ágiles, dinámicas y eficientes, mediante el uso de trámites en línea, la automatización de procesos, chatbots que orienten y brinden información a la ciudadanía, entre otras herramientas capaces de ofrecer mayor productividad y optimización de recursos.

Aunado a lo anterior, existen otros usos y aplicaciones de la IA, tan variadas como las propias áreas de acción del sector público: la educación, el transporte, la salud. Incluso la Analítica, el Big Data y el Machine Learning que ya son utilizados por los gobiernos para la toma de decisiones en el diseño de estrategias y planes de mejora en ámbitos sociales, pero sobre todo en la prevención de delitos cibernéticos.

De acuerdo con la Policía Cibernética de la Guardia Nacional, 84 por ciento de los delitos cibernéticos se relacionan con la propagación de código malicioso; 6 por ciento se trata de sitios web fraudulentos; 4 por ciento intentos automatizados para conseguir contraseñas y 3 por ciento tiene que ver con ataques a la ciberseguridad en infraestructuras tecnológicas.

Respecto a incidentes de seguridad, donde se puso en vulnerabilidad la información de ciudadanos, el periódico El Economista elaboró un recuento de 12 hackeos ocurridos en 2020 y de los que fueron víctimas organismos como el Banco de México, la Secretaria de Administración Tributaria (SAT) y la Secretaria de la Función pública, por mencionar algunos que nos permiten magnificar los alcances del uso de la IA por la ciberdelincuencia.

¿Regular la inteligencia artificial?

En 2017 Elon Musk, cofundador y líder de la compañía Tesla, solicitó al gobierno estadounidense reglamentar la inteligencia artificial “antes de que sea demasiado tarde”, “necesitamos ser proactivos en lugar de reactivos. Porque en el momento en que seamos reactivos en su regulación será demasiado tarde”, mencionó durante una reunión con gobernadores, ante quienes sugirió “aprender lo más posible” del tema, ya que eso ayudará a entender mejor el problema.

En un artículo publicado en The New York Times, Oren Etzioni, profesor de informática y director ejecutivo del Instituto Allen de Inteligencia Artificial en Estados Unidos, propone tres reglas para regular la inteligencia artificial:

- que cualquier sistema con inteligencia artificial debe someterse al amplio espectro de leyes a las que se somete su operador humano. En ese sentido, señala como necesaria la modificación de los códigos penales;

- que un sistema de IA debe exponer con claridad que no es humano, de manera que los usuarios puedan identificar a algún robot que intenta suplantar alguna identidad;

- que un sistema de IA no pueda guardar ni difundir información confidencial sin la aprobación explícita de la fuente, sobre todo ante su cada vez más amplia capacidad de analizar la información.

A finales de 2020, la Unión Europea hizo formal su propuesta de desarrollar una regulación para la Inteligencia Artificial “un sólido marco reglamentario basado en los derechos humanos y los valores fundamentales“. Según señala en su sitio web, esto “ofrecerá a los ciudadanos la confianza necesaria para adoptar estas tecnologías, animando al mismo tiempo a las empresas a desarrollarlas“.

En ese sentido la comisión Europea propone:

- una nueva legislación sobre la IA adaptada a los riesgos, pero sin limitar la innovación;

- la obligación de que los sistemas de IA de alto riesgo sean transparentes y rastreables y estén bajo control humano;

- facultades para las autoridades a la hora de verificar los sistemas de IA, tal como ya hacen con los cosméticos, los automóviles o los juguetes;

- conjuntos de datos libres de sesgos; impulso a un debate en toda la UE sobre el uso de la identificación biométrica remota (por ejemplo, el reconocimiento facial).

Asimismo, Sundar Pichai, CEO de Google, reconoció en su momento que «la inteligencia artificial debe ser regulada» y que en esa tarea «los gobiernos tienen un papel fundamental», ya que recordó que «la historia está llena de ejemplos de cómo las virtudes de la tecnología no están garantizadas».

En ese sentido, es importante destacar el papel de los gobiernos en la adecuación del marco legal en torno a los delitos cometidos mediante sistemas de IA, ya que éstos, al menos hasta ahora, tienen como punto de partida la programación hecha por un cerebro humano, por lo que no queda más que apelar a estándares de ética y legalidad adaptados a la aplicación de nuevas Tecnologías de la Información.